AIハルシネーションとは?士業が知るべき誤答リスクと実務的な対策

AIハルシネーションとは

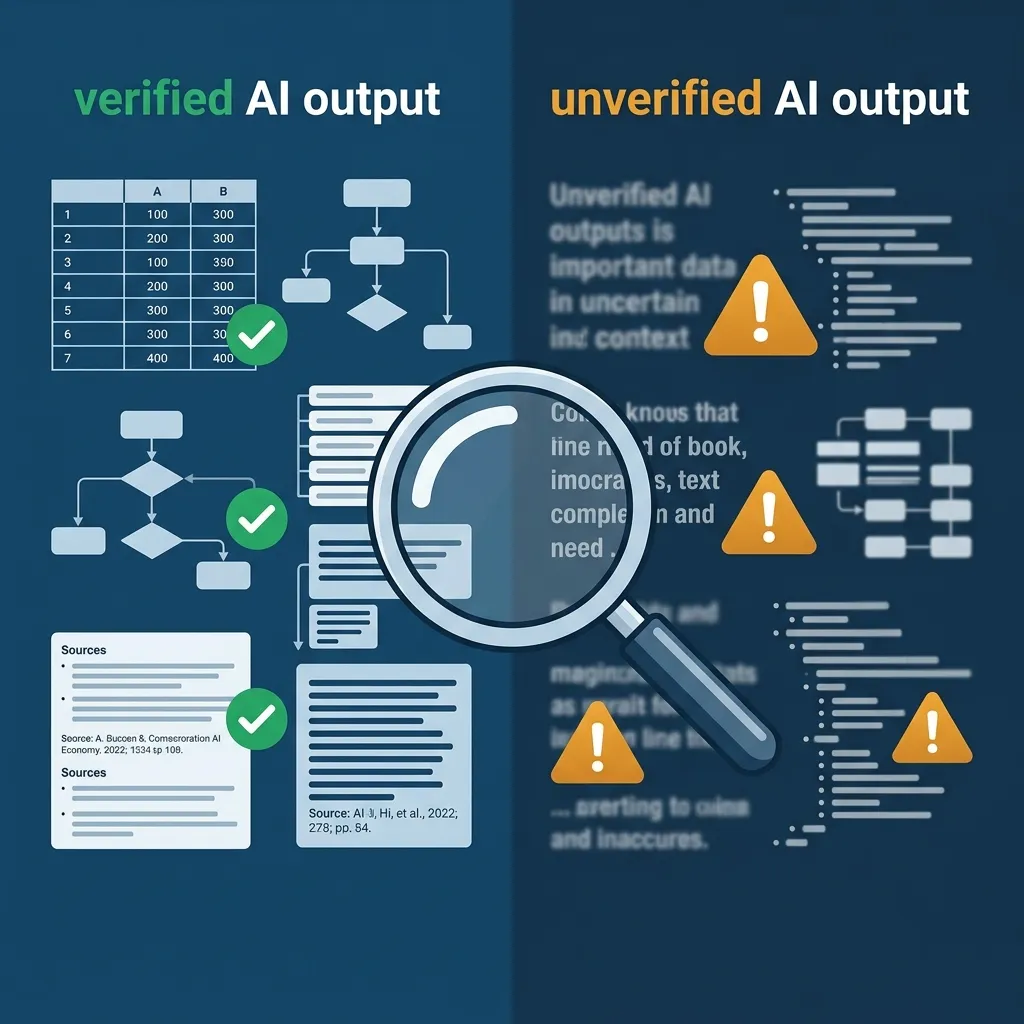

AIハルシネーションとは、AIが事実に基づかない情報をもっともらしく生成する現象のこと。 正確な根拠がなくても、まるで正しいかのような自然な文体で誤情報を出力する。

一般的な文書作成であれば「参考程度」で済む場面もある。しかし弁護士・税理士・社労士のような士業では、誤答一つが顧客への誤指導・助言責任・申告ミスに直結する。汎用AIをそのまま実務に使うことが危険とされる最大の理由が、このハルシネーションだ。

士業で特に危険な3つのハルシネーションパターン

1. 存在しない条文・判例の引用

AIは、存在しない法条文や架空の判例を自信満々に引用することがある。 「○○法第△条」と示されても、実際には存在しない条文番号のケースが報告されている("hallucinated cases"問題)。弁護士業務や契約書レビューで最も警戒すべきパターンだ。

2. 改正前後の制度混同

学習データのカットオフ以前の税率・助成金要件・労務規定を、現行制度として出力するリスクがある。 廃止された補助金、変更された税率、旧来の申請要件などが「最新情報」として提示されることがある。税理士・社労士の実務で特に危険。

3. 通達・ガイドラインの脱落

条文そのものは正しくても、実務上の運用を定める通達や関連ガイドラインを無視した回答になるケースがある。 法令の字義だけを追い、厚労省通達・国税庁の運用基準を落とした回答は、実務では使えない。

なぜ汎用AIでは防げないのか

学習データのカットオフ問題

ChatGPTなどの汎用AIは、特定時点までのデータで学習している。制度改正・新通達・最新判例は学習データに含まれない。リアルタイム検索機能があっても、情報の取捨選択は保証されない。

RAG(検索拡張生成)の限界

RAGは外部文書を検索してAIに渡す仕組みだが、どのソースを参照するか・どこまで信頼するかを業務レベルで制御しにくい。文書の混在・ソースの重みづけ・出典の透明性に課題が残る。

確率的生成の本質的制約

そもそも大規模言語モデルは「確率的に次のトークンを予測する」構造だ。正確さより流暢さを優先する設計上、「それらしい誤答」は避けられない。精度向上は進んでいるが、ゼロにはならない。

実務的な対策5選

1. 参照元を制約する(MCP設計)

AIが参照できる情報源を「信頼できるソースのみ」に絞る。MCP(Model Context Protocol)を活用することで、法令データベース・社内規程・認定ガイドラインだけをAIの参照先として接続できる。ソース境界の固定が最も根本的な対策だ。

2. 出典トレーサビリティの確保

AIの回答に必ず出典(条文番号・通達番号・参照文書名)を付けさせる運用を徹底する。「AIがそう言った」ではなく「○○法第△条に基づく」と説明できる状態を維持することが、士業の助言責任を守る条件だ。

3. ダブルチェック体制の構築

AI出力を最終回答として使わず、担当者によるファクトチェックのフローを必ず挟む。特に条文引用・数値・制度要件は原文照合を標準手順にする。AIは「調査の初速を上げるツール」として位置づける。

4. PoC段階での精度検証

本番導入前に、実際の業務ケースでハルシネーション発生頻度を計測する。「使えそう」という印象ではなく、誤答率・出典精度・制度適合率を数値で確認することが必要だ。

5. AI利用ガイドラインの策定

事務所・チームとしてAI使用ルールを文書化する。「どの業務にAIを使ってよいか」「出力をどう検証するか」「誰が最終責任を持つか」を明文化することで、属人的なリスク判断を防ぐ。

MCPが解決する根本問題

汎用AIのハルシネーション対策として、MCP(Model Context Protocol)による参照設計は特に有効だ。

- ソース境界の固定: AIが参照できる情報源を信頼できるデータベースのみに制限

- 出典付き回答: 「何を根拠に答えたか」をトレース可能な状態で出力

- 回答範囲の制約: ソース外の情報について「わからない」と返すよう設計できる

これにより、「それらしい誤答」ではなく「根拠付きのたたき台」をAIに出力させることが可能になる。

よくある質問

Q: AIハルシネーションはなぜ起きるのですか?

A: 大規模言語モデルは「確率的に自然な文章を生成する」仕組みのため、正確性より流暢さが優先されることがある。学習データに含まれない情報や、データが少ないトピックでは特に発生しやすい。根本的な構造上の制約であり、モデルの性能向上で減少はしても、ゼロにはならない。

Q: ChatGPTのハルシネーションを完全に防ぐ方法はありますか?

A: 完全な防止は現時点では不可能。ただし、参照ソースの制約(MCP設計)・出典付き出力の義務化・人間によるファクトチェックの組み合わせで、実務リスクを許容範囲に抑えることは可能だ。「ゼロリスク」ではなく「管理可能なリスク」を目指すのが現実的なアプローチ。

Q: 士業でAIを使う際のガイドラインはありますか?

A: 2024年以降、弁護士会・税理士会・社労士会それぞれがAI活用に関する指針・注意喚起を発表している。ただし各会の指針は概論レベルが多く、個別業務への適用は各事務所の判断に委ねられている。Kanau Tech™では、士業向けの実務レベルのAI活用設計・ガイドライン策定支援も行っている。

Q: MCPを使えばハルシネーションはゼロになりますか?

A: ゼロにはならない。ただし、MCP設計によって「参照できる情報源を信頼できるソースに限定する」ことで、制度誤認・架空引用・古い情報の混入リスクを大幅に低減できる。ソース外の質問には「回答できない」と返す設計が可能なため、汎用AIよりはるかにコントロールしやすくなる。

関連記事:

- 2026年版 中小企業のための生成AI業務活用 完全ガイド:IT導入補助金×AI規制×業界別事例 — AI事業者ガイドライン1.2版で要件化された「人間の判断介在」の最新整理

- 税理士のAI活用 — 税法MCPで改正追跡と出典付き回答を実現する方法

- 社労士のAI活用 — 労働法MCPで顧問先支援を効率化する設計

士業・管理部門向けに、誤答コストを抑えたAI活用設計を支援しています。勉強会・社内研修・導入相談にも対応可能です。まずはお気軽にお問い合わせください。